特集「感触」や「音」をリアル に再現!名城大学の「次世代VR研究」

柳田研究室

視覚に加え、嗅覚や触覚など、 人間の感覚提示技術に関する研究を行っています。

理工学部 情報工学科 博士(工学)

柳田 康幸 教授

Yasuyuki Yanagida

視覚に加え、嗅覚や触覚など、 人間の感覚提示技術に関する研究を行っています。

触覚へのアプローチ

触覚に関する研究開発は指先への事例がほとんどですが、当研究室では、全身に対して触覚刺激を行うことで、より身体性を利用した情報提示を目指しています。

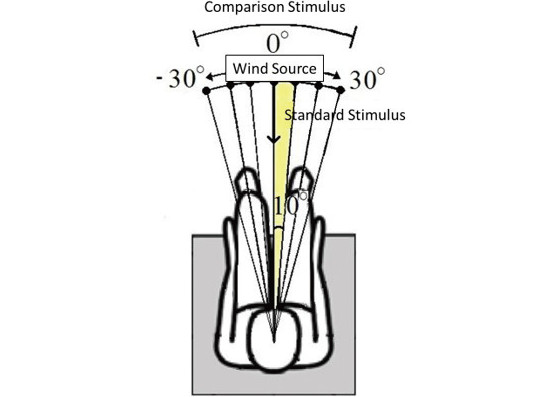

風向提示装置

風向知覚実験

人間の風向知覚特性の解明

風を使って移動感を表現できれば、VR環境下でよりいっそう臨場感を演出することが可能です。図のように、さまざまな方向から風を提示できる実験装置をつくり、人間がどのように風の方向を判別しているかを調べました。

空気塊による局所型温湿感提示

香りプロジェクターと同じ原理を使い、温度や湿度が異なる空気の塊を局所的に届ける実験を進めています。これにより、炎が燃えているシーンでの暑さや、氷や雪のシーンでの寒さ、森林に足を踏み入れたときの湿度感などの実現を目指しています。

嗅覚へのアプローチ

映像メディアの親和性を考え、機器を装着することなく、場面に応じて香りが瞬時に切り替わるシステムを目指しています。

香りプロジェクター試作機

「空気砲」の仕組みを応用。香料を空気の渦の輪の中に閉じ込め、狙った場所まで香りを搬送します。

香りプロジェクターは、何も身につけてなくても香りを楽しめる「非装着」型でありながら、広い空間において、特定の時間、特定の人だけへ香りを届けることができる装置です。何回もの試作により、鼻追従機能、香り切り替え機能が順次追加されました。現在は、2台の香りプロジェクターを使って香りの空気を衝突させ、その場に漂わせることにより、空中にバーチャルな匂い源(香りのスポット)を実現する技術開発などを行っています。

国際学生対抗バーチャルリアリティコンテストで総合優勝

17年10月28日、理工学部情報工学科柳田康幸教授研究室「甘味処『もっちー』」チームが、東京都の日本科学未来館で開かれた第回国際学生対抗バーチャルリアリティコンテスト(IVRC2017)で総合優勝を果たしました。

チームメンバーは渡辺久馬さん、荒川翔さん、池口淳弥さん、岩田将幸さん、大塚貴碩さん、関野裕亮さん、竹内元康さん、森湧翔さん(全て年生)。「餅餅(Hey!もち)」と名付けられた本装置では、餅をついたときの弾力感、餅がつき上がるにつれて増していく粘り感の再現に成功し、餅つきのバーチャルな体験を味わえます。

IVRCは1993年から毎年開催されている歴史あるコンテストで、これまでにも、VRの概念を広げるような、独創的で親しみの持てる作品が数多く生み出されています。

今大会においてはまず、全国138チームの企画応募の中から一般学生部門チームが予選大会に出場し、筑波大学で体験型展示による審査が行われました。本学チームは、予選を位で通過し、来場者の人気投票によって与えられる「VREXPO観客賞」を受賞。その約1カ月後に開催された決勝大会では、東北大学や東京工業大学をはじめとする国内チームと、フランスからの招待作品1チームが競い、本学チームの総合優勝で幕を閉じました。

西野研究室

名古屋大学大学院工学研究科電子情報学専攻博士課程後期課程単位取得退学。日本音響学会、電子情報通信学会、情報処理学会所属、2017年度より現職。最近は、音楽CDからそれぞれの音を取り出し、3次元空間に自由に配置することができる「自由聴点オーディオ」の研究開発に参加している。

都市情報学部 都市情報学科 博士(工学)

西野 隆典 教授

Takanori Nishino

視覚と聴覚が連動したコンテンツの制作

人間が音を捉える能力は非常に高く、聴覚のみに神経を集中した状態では、音源のわずかな変化がわかるほど。一方、映像などと組み合わせると、視覚に意識が引っ張られ、精度がかなり下がることもわかっています。音は、空間の形や障害物、空間にいる人の数などさまざまな要因で変化するため、音だけですべてを再現する技術の構築はかなり難しいのです。

響く感覚など、耳からの情報以外の要因を組み合わせながら、リアリティーに富んだ映像と組み合わせることで、コンテンツの臨場感をさらに高めることができると思います。今後、当研究室では人間のさまざまな感覚に着目したVRゲームの制作などを行う予定です。新しい動き、新しい体験を提供できるコンテンツができればと期待しています。

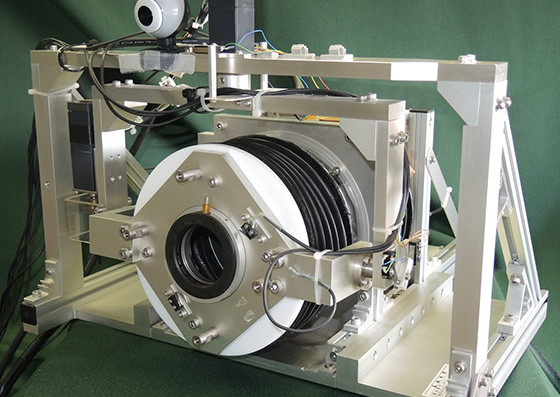

固定視点によるバイノーラル録音

私たちの耳は、周囲の障害物や自身の体、耳たぶなどに反射した音を捉えています。普段、意識せずとも音源までの距離や音源の動きなどを認識することができる理由は、無意識のうちに音のわずかな違いを聞き分けているから。人が聞いている音をそのまま記録することを「バイノーラル録音」と言い、右の写真はそれを行うための装置です。マイクの周囲のくぼみが耳の形を模していて、人間の耳と同じように音を拾うことができます。この装置はマイク単体でも使えますが、上部にカメラをセットすることで、視覚と聴覚が連動したコンテンツをつくることも可能です。この装置で撮影した動画を、右のQRコードから視聴することができます。ヘッドホンもしくはイヤホンで聞いてみてください。実際に線路脇に立っているかのような臨場感を味わえます。

左右別々の音を認識して、音源との距離を測っていることがわかります。

視点の変化に伴うバイノーラル録音

視点の位置が変われば自動的に耳の位置も変わるため、音の聞こえ方が変わります。右の写真は、その変化を捉えるための装置です。複数のビデオカメラと複数のマイクが全面に取り付けてあり、360°撮影しながら、視点と音の変化を同時に記録しています。(下記動画の音声はテスト段階です)

実際の撮影の様子

会場のアナウンスやボールが跳ね返る音など、視点と音が連動するような処理を目指しています。